- 現在位置

- トップ > 白書・統計・出版物 > 白書 > 科学技術・イノベーション白書 > 令和6年版 科学技術・イノベーション白書 > 令和6年版科学技術・イノベーション白書 本文(HTML版) > 第3章 AI関連研究開発の世界の動向

第3章 AI関連研究開発の世界の動向

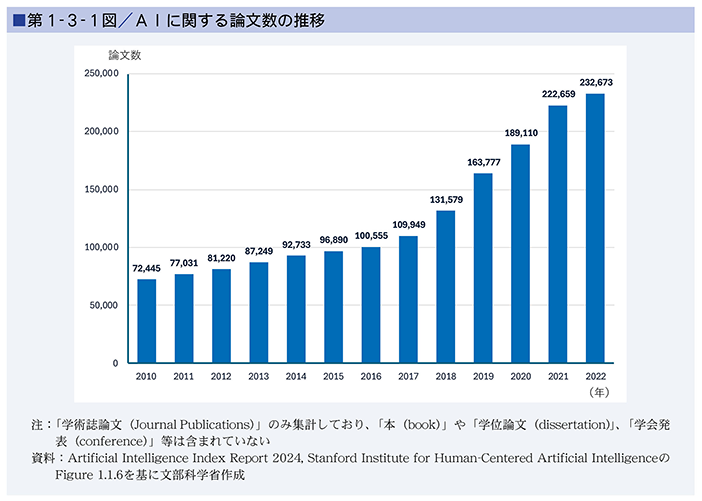

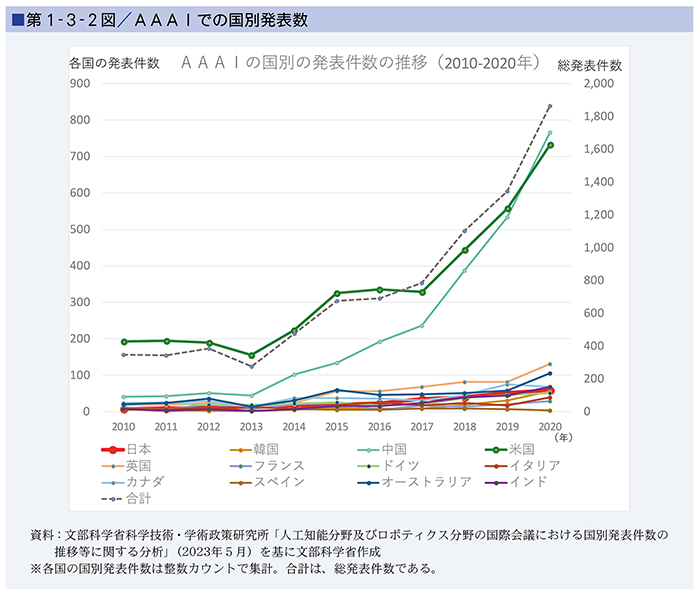

第1章で見てきたように、AI研究はブームを繰り返してきていますが、第3次ブーム以降、米国や英国、中国をはじめ世界のAIに関する民間投資は増加傾向にあるとともに(※1)、論文数も2010年以降、3倍以上増加しています(第1-3-1図)。また、AAAI(※2)などのAIに関する主要な国際会議での発表数や投稿数も、全体的に増加傾向にある中、これまで米国がリードしてきましたが、近年、中国が追い上げ、米中2強という状況になりつつあります(※3)(第1-3-2図)。

同時に、誤情報や安全性・透明性についての懸念から、AIのELSIについても関心が高まっており、国際的な議論が始まっています。このような中、各国では、AI技術に携わる人材の育成や、AIの利活用に係るルールなどを整備しながら、AIに関する国家戦略を策定し、研究開発を推進しています。本章では、AIの研究開発を進める主要な国・地域の動向を紹介するとともに、国際的な議論や多国間の連携・協働についても説明します。

第1節 主要国・地域におけるAIに関する研究開発戦略

1-1.米国

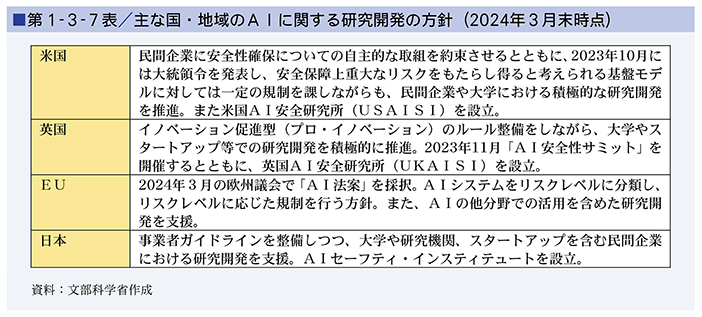

米国政府は、AI分野の研究開発を戦略的に進めるため、2016年に「国家AI研究開発戦略(National AI R&D Strategic Plan)」を策定し、AI研究への長期的な投資、人間とAIの協調、倫理的・法的・社会的影響の理解等に重点的に取り組む方針を示しました。同戦略について、2019年の改訂の後、2023年5月には更なる改訂版を公表し、戦略的な国際連携に関する取組も新たに追加しています(※4)。そして、「2020年国家AIイニシアティブ法(※5)」に基づき、2021年1月、「国家AIイニシアティブ室(NAIIO(※6))」が大統領府科学技術政策局(OSTP(※7))に設立され(※8)、NAIIOが、国家科学技術会議(NSTC(※9))に置かれたAI特別委員会(SCAI(※10))と共に、AIイニシアティブに関する省庁間調整等を行っています。また、商務省に設置された国家AIイニシアティブ諮問委員会(NAIAC(※11))が、AIに関する諸問題について、大統領やNAIIOに助言を行うこととなっています。このように、政府全体のAI戦略を推進するため、政府、民間企業、学界、その他の関係機関の間の調整・連携が進められています。

また、第1章で見てきたような高度AI技術の急速な進展と関心の高まりを受けて、米国のバイデン政権は、2023年5月に責任あるイノベーションのための取組方針を示すとともに、同年7月にはAIに関する研究開発を牽引(けんいん)する民間事業者7社(Amazon社、Anthropic社、Google社、Inflection社、Meta社、Microsoft社、OpenAI社)が、9月には更に8社(Adobe社、Cohere社、IBM社、NVIDIA社、Palantir社、Salesforce社、Scale AI社、Stability社)が安全性、セキュリティ、信頼性という三つの原則に基づいて自主的な取組を約束したことを発表しています(※12)。また、2023年10月、バイデン大統領は、「AIの安全、安心で信頼できる開発と利用に関する大統領令」に署名しました(※13)。この大統領令には、「国防生産法(Defense Production Act)」に基づき、重大なリスクをもたらす基盤モデルの開発者に対して、安全性評価の結果を政府に共有することを義務付けることなどが含まれています。本大統領令を踏まえ、11月には、商務省傘下の国立標準技術研究所(NIST(※14))内に米国AI安全研究所(USAISI(※15))を設立することなどを含めた、安全で責任ある利用を推進する新しいイニシアティブを発表しています(※16)。また、著作権に関しては、米国著作権局(USCO(※17))は、2023年8月、生成AI技術がもたらす著作権法及び政策上の課題の調査を目的として意見募集を行っています(※18)。

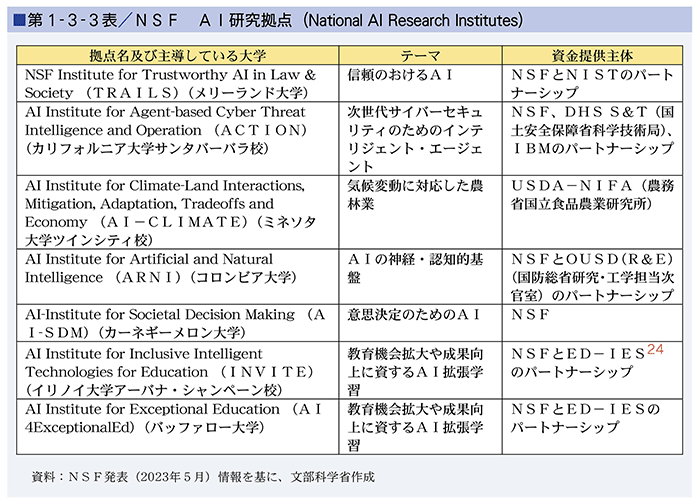

このような政策や体制の下、研究開発については、米国・国立科学財団(NSF(※19))が、他の連邦政府機関や高等教育機関、その他関係機関と連携して、2020年からAI研究拠点のネットワーク形成を進めています。また2023年5月には、第1-3-3表に示す七つのAI研究拠点の新設を発表(※20)しており、これまでに、新設7拠点を含む計25の研究拠点に対して約5億ドルの支援を発表しています。各拠点では、学際的な研究や次世代の人材育成などにも取り組んでいます。また、NSFは、同年10月、安全性のあるAIの開発を推進する、大学等における計11の研究プロジェクトに、総額1,090万ドルを助成することを発表しています(※21)。

さらに、2023年1月には、あらゆる分野の研究者や学生が活用可能な計算資源やデータ、教育ツール等の基盤の整備方策について検討を行っていた「国家AI研究リソース(NAIRR(※22))タスクフォース」の最終報告書がまとめられ(※23)、2024年1月、同報告書で掲げられたビジョンの実現に向けて、NSF主導の下、複数の省庁や企業等が参画して、様々なパイロットプログラムが開始されています(※25)。

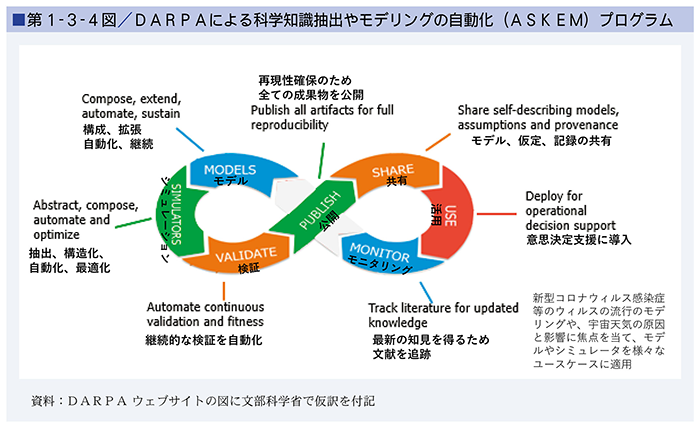

また、国防高等研究計画局(DARPA(※26))は、2018年、次世代AI技術の開発のため、「AI NEXT Campaign」と称した取組を、複数年にわたり総額20億ドル以上を投じて進めることを発表しています(※27)。さらに、現代社会におけるタイムリーな脅威の検出や意思決定に資するモデリングやシミュレーションの自動化、強化を目指して、2021年12月、「科学知識抽出やモデリングの自動化(ASKEM(※28))プログラム」を開始し(※29)(第1-3-4図)、採択された国内外の大学や企業等の研究開発を支援しています(※30)。

産業界では、Google社、Microsoft社、Amazon社などのIT大手企業が、AIをコア技術として、様々な事業を展開しています。例えばGoogle社は、AIを活用した検索、翻訳、音声認識といったソフトのサービスのみならず、対話型生成AIである「Gemini(旧Bard)」や、AIを活用した自動運転技術の開発などにも取り組んでいます。またMicrosoft社は、AIを活用したクラウドコンピューティング、AIプラットフォームなどのサービスを展開するとともに、AIを活用した医用画像の診断支援システムや、学習用教材の開発にも取り組んでいます(※31)。

1-2.英国

英国では、1950年に数学者アラン・チューリング博士により発表された論文がその後のAI研究の起源ともなっているように、大学を中心にAIに関する基礎研究から応用研究まで幅広く研究開発が行われてきています。そのような強みを生かして、英国政府では、AIを安全で信頼できる技術として発展させ、経済成長と社会の持続的発展への寄与を目指すという方針の下、特に2010年代以降、研究開発や産学官の連携、データ共有等について、積極的に様々な政策を講じてきています。

具体的には、2012年に発表された八つの国家重要技術(Great Technologies)の一つにビッグデータを取り上げ、2015年にデータ・サイエンスの研究を行うアラン・チューリング研究所(Alan Turing Institute)(※32)を国立の研究機関として設置しました。また、2010年にデミス・ハサビス氏により設立されたスタートアップのDeepMind社が2014年にGoogle社に買収されたことや、国際的な機械学習への関心の高まりも受け、アラン・チューリング研究所を中心としたAIの研究が拡充(※33)されるとともに、2019年には国民保健サービス(NHS(※34))を担当するNHSX(※35)(当時)の中にNHS AI Lab(※36)を設置することが発表されるなど、政府機関による国民サービスにおけるAIの活用も進められてきています。

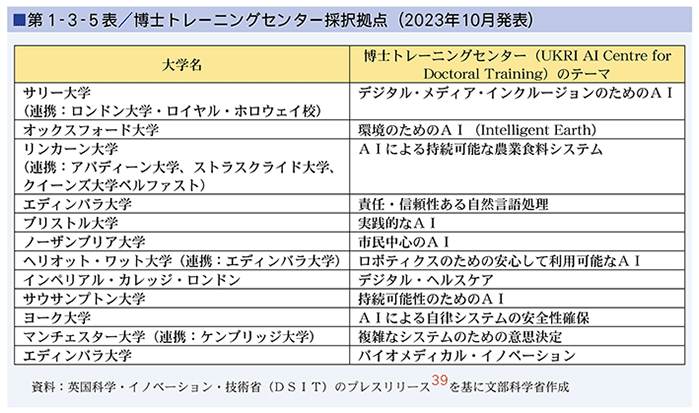

さらに、英国政府は、2021年9月に、英国を世界的なAI強国とするための10年計画として「国家AI戦略(※37)」を発表し、翌2022年7月に「行動計画(※38)」を策定しています。現在は、科学・イノベーション・技術省(DSIT(※40))に設置されているAI担当室(Office for Artificial Intelligence)が国家AI戦略の監督責任を負っています。そして、2023年3月に発表した「UK Science and Technology Framework(※41)」の中で、AIを五つの重要科学技術の一つと位置付けるとともに、AI分野の研究者の育成・支援政策を発表し(※42、※43)、英国研究・イノベーション機構(UKRI(※44))を通じて、責任ある信頼できるAIの確立を目指した研究や人材育成を行う大学に対して支援が行われています(第1-3-5表)。

同時に、研究開発だけでなく、AIの社会への影響に関する研究や議論が積極的に行われてきています。オックスフォード大学には、2015年に「戦略的人工知能研究センター(SAIRC)(※45)」が、ケンブリッジ大学には、2016年に「未来のインテリジェンスLeverhulme研究所(※46)」がそれぞれ設立され、AIによる雇用等への影響や安全性についての研究が積極的に進められてきました。このような背景の下、英国政府は、2023年3月、イノベーション促進(プロ・イノベーション)型のAIの規制の方針を発表しています(※47)。その後、最先端AIのリスクをまとめるとともに(※48)、2023年11月には、AIの安全な開発と活用に関する国際的な会議として、「AI安全性サミット」を英国で開催しました(※49)。本サミットにはG7を含む各国首脳・閣僚級のほか、国際機関、主要なAI企業、有識者等が参加し、AIの急速な発展を踏まえた最先端AIに関するリスク理解の促進を図るとともに、国際的に協調した取組を進めていくことなどが盛り込まれた「ブレッチリー宣言(Bletchley Declaration)」が採択されました。我が国からは、首脳級会合に総理大臣、閣僚級会合に総務大臣政務官が出席し、AIが極めて大きな潜在性を有すると同時にリスクもはらんでいることを前提に人類の英知を結集して適切なAIガバナンスを国際的に確立することが重要であることを表明しました。また、英国政府は、AI安全研究所(UKAISI(※50))の設置を発表し、今後、国際パートナーとも連携しながら、最先端AIの安全性を検証していくこととなっています。

英国議会では、上院通信・デジタル委員会がLLMと生成AIに関する調査を行い、2024年2月に報告書を発表する(※51)とともに、AIに関する議員提出法案についての議論も行われています(※52)。

また、英米両政府は、AI研究に関する開発プロセスの一つである連合学習について、グローバルに連携した研究開発の推進を目的として、「プライバシー強化技術(PETs(※53))促進チャレンジ」を2022年7月に開始しました(※54)。このチャレンジでは、「金融犯罪の防止」と「感染症パンデミックの予測」という二つの課題への解決策を開発者に提示してもらい、構想調書の提出、本物に近い疑似的なデータでの実際の開発・学習、そして同様にチャレンジ参加者となったチームからのプライバシー攻撃への防御耐性という三つの工程が審査されました。最終的に2023年3月に受賞者が発表され、英米両政府及び関係機関が用意した130万ポンド(160万ドル)が賞金として与えられました(※55)。

1-3.欧州連合(EU)

EUでは、データガバナンスと規制に重点を置いた議論が進められるとともに、AIの開発と利用に関する環境整備を進めています。また、第4章に示すとおり科学におけるAIの活用についての議論も進められています。

まず、欧州では、データの安全性とプライバシーを保護するための規制である「一般データ保護規則(GDPR)」が2018年に施行されました。GDPRは、EU域内で個人データを収集・利用する企業に対して、データ主体の同意取得、データの安全性確保、データの移転制限などの義務を課しています。その際には、AIシステムの開発や利用においても、EU域内の個人データを収集・利用する場合には、GDPRの遵守が求められます。

そのような中、2018年、「AI for Europe」と題した戦略(※56)が策定され、欧州の技術的・産業的能力の強化や、倫理的・法的枠組みの確保などの方向性が示されました。

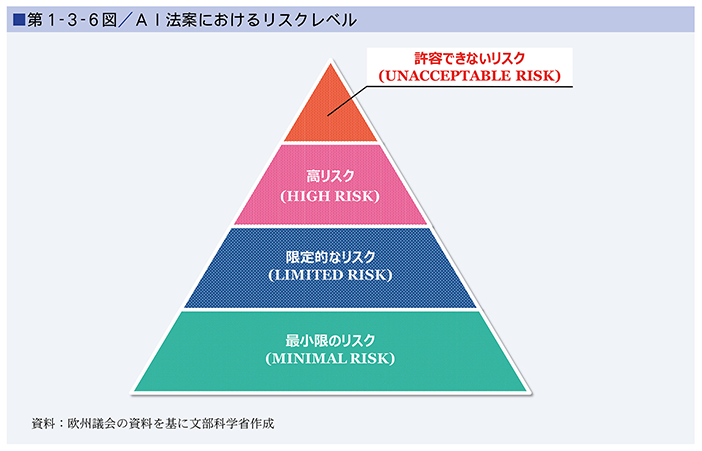

このうち、法的な枠組みの確保に関しては、欧州委員会は、2021年4月に、「AI法案」を提案し、その後の議論により修正が重ねられた上で、2024年3月、欧州議会で、同法案が採択されました(※57、※58、※59)。同法案は、AIの安全性と倫理を確保し、AIがEUの価値観に沿った形で開発・利用されるようにすることを目的とし、AIの開発・利用に適用される一般原則を定めるとともに、特定のリスクを伴うAIシステムの開発・利用に規制を適用することとしています。具体的には、AIシステムの開発、使用、運用に際して遵守すべき義務を定めており、AIシステムを4段階のリスクレベル(許容できないリスク、高リスク、限定的なリスク、最小限のリスク)に分類(第1-3-6図)し、リスクレベルに応じた規制及び罰則を適用するというリスクベースのアプローチを導入しています。なお、本法案はEU加盟国に所在する事業者のみならず、EU域内において高リスクのAIサービスを提供しようとしたり、市場に参入しようとしたりする第三国の事業者に対しても適用されます。さらに、汎用目的AI(GPAI(※60))システムとそのベースとなるGPAIモデルに関しては、重大な汎用性を示しながらも、広範囲の明確なタスクを適切に実行でき、かつ様々な下流のシステムやアプリケーションに統合できるAIモデルと位置付けられることから、よりシステミックなリスク(システム全体に波及するリスク)を引き起こす可能性への懸念からも、一定の透明性を確保するための条項や、追加のリスク管理を求める条項などを導入する案が議論されました。

また、欧州フレームワークの中で、機械翻訳を中心に研究開発に対しても支援がなされてきているとともに、2024年1月には、欧州委員会は、AIイノベーションの支援に向けた政策パッケージを発表し(※61)、スタートアップや中小企業などを対象とした支援の枠組みを提示しています。その中には、域内で整備が進むEuroHPC JU(※62)スーパーコンピュータを活用してスタートアップや中小企業による開発・利用を促進する取組や、欧州としてのAI政策の調整等を行うため欧州委員会内にAIオフィスを設置することなどが含まれています。

1-4.ドイツ

ドイツは2018年に「AI戦略(Nationale Strategie für Künstliche Intelligenz)」を発表し、ドイツ及びEUをAI技術の先導国とすることや、AIへの投資の刺激、AI研究エクセレンスセンターネットワーク(※63)の発展、研究資金配分スキームの再考などによって将来のドイツの競争力を確保することを掲げるとともに、EUのAI戦略も積極的に推進し、EU全体の取組と同様、データガバナンスの整備をAI戦略の重要な柱と位置付けています(※64)。

また、2020年には、本戦略を更新し(※65)、AIの幅広い応用を強化すると同時に、優れた取組や構造の認知度を高めるために、ドイツと欧州におけるAIのエコシステムを更に確立・拡大する必要があるとしています。「共通の善」(公共の利益)のためのAIシステムの責任ある開発と応用は、「AI Made in Europe」の特徴かつ不可欠な部分であるとし、さらに、パンデミック対策、持続可能性、特に環境と気候保護、国際的・欧州的なネットワーク構築といったテーマが、新たなイニシアティブの中心となっています。

1-5.フランス

フランスでは、歴史的にも基礎数学分野の研究に強みを有し、AIに関する研究や人材育成を積極的に進めてきており、2021年10月に発表された2022年から2026年までの政策投融資計画「フランス2030」においても、AIは重点投資分野の一つとして掲げられています(※66)。

具体的には、2018年11月に「国家AI戦略(※67)」を発表し、AIを安全で信頼できる技術として発展させ、フランスの経済成長と社会の持続的発展に貢献することを目指して、国立情報学自動制御研究所(Inria(※68))が主導するAIプログラムの全国展開や、フランス国立研究機構(ANR(※69))におけるAI研究の強化、AI人材育成、計算資源の増強、二国間・欧州域内・国際協力の強化等の取組に対して、2022年までの4年間に総額6億6,500万ユーロを措置することが計画されました。

また、2021年11月には、同戦略の第2段階の開始を発表し(※70)、これまでの訓練を受けた人材の数を増やすとともに、経済におけるAI技術の普及に焦点を当てて、今後5年間でAI分野に、官民で合計22億2,000万ユーロを投資することも示されています。さらに、2023年9月には生成AI委員会が発足し(※71)、様々な分野(文化、経済、技術、研究)の関係者を集めて、政府の決定に情報を提供し、フランスをAI革命の最前線に立つ国とすることを目標に活動しています。

1-6.イタリア

イタリアでは、2021年11月、技術イノベーション・デジタル移行担当大臣が「AI戦略プログラム2022-2024(※72)」を発表し、同国のAIに関する研究エコシステムを俯瞰(ふかん)・国際比較した上で、2024年までの、六つの目的と11の優先投資分野、及び三つの目標達成方策が示されています。

具体的には、六つの目的として、①AIのフロンティア研究を推進すること、②AI研究の分断を減らすこと、③人間中心で信頼できるAIの開発と採用を進めること、④AIを活用したイノベーションとAI技術の開発を促進すること、⑤公共部門におけるAI主導の政策とサービスを開発すること、⑥イタリアにおいてAI人材を創出、維持、誘致することが掲げられています。これらを達成するため、(1)スキルの強化と人材の確保、(2)AIに関する先端研究への投資の増加、(3)行政及び生産部門全般におけるAIの活用促進の三つの方策を提示しています。

1-7.カナダ

カナダでは、深層学習の先駆者であるジェフリー・ヒントン・トロント大学名誉教授やヨシュア・ベンジオ・モントリオール大学教授らに牽引(けんいん)されながら、政府による支援の下、大学等における最先端のAI研究開発が進められています。カナダ先端研究機構(CIFAR(※73))による支援の下2004年に開始された、ヒントン教授(当時)らによる「Neural Computation and Adaptive Perception」プロジェクトが、現在の機械学習研究の先駆けとなりました。2012年にはヒントン教授(当時)が率いるトロント大学のチームが、「深層畳み込みニューラルネットワーク」を用いて、高い精度の画像認識技術を示して世界的な注目を集め、ヒントン教授(当時)が起業したスタートアップ企業DNNresearch社が2013年にGoogle社に買収されたことなどから、トロントやモントリオールなどに大手テクノロジー企業が研究開発拠点を設置し、またAI関連のスタートアップ企業も集積してきています(※74)。

このような優れた研究や人材を土台として、カナダ政府は、2017年3月、「汎カナダAI戦略」と題した国家戦略を発表し(※75)、さらに2022年6月には同戦略の第2段階の開始を発表(※76)して、①商用化、②標準、③人材育成と研究開発の三つの柱に沿って、様々な取組が展開されています。

具体的には同戦略の第1期では、カルガリー州エドモントンのアルバータ・マシン・インテリジェンス研究所(Amii)(※77)、ケベック州のモントリオール学習アルゴリズム研究所(Mila)(※78)、オンタリオ州トロントのベクター(Vector)研究所(※79)という三つの国立のAI研究所を中心とした研究・イノベーション・トレーニングのセンター設立など、人材育成とエコシステム構築を目的として、2017年からCIFARなどを通じた取組が展開されました(※80)。

第2期では、世界クラスの人材と最先端の研究能力を商業化に結び付け、カナダが有するアイディアと知識の国内での実用化を確実にすることを目指した取組が、カナダ全土でパートナーシップを構築しながら展開されています。2023年10月には、本戦略に基づくこれまでの取組のインパクトを取りまとめ発表しています(※81)。2024年3月にはラヴァル大学にAI研究を支えるためにコンピュータ・クラスター創設のための支援が発表されました(※82)。

また、2023年9月、カナダ政府は、「高度な生成AIシステムの責任ある開発と管理に関する自主行動規範」を発表しています(※83)。汎用性のある生成AIシステムの運用を開発・管理する全ての企業が、AI・データ法(※84)に基づく拘束力のある規制に先立って、適用すべき措置及び、これらのシステムの運用を開発・管理する企業が執るべき追加的措置を特定しています。

1-8.中華人民共和国(中国)

中国では、大規模な政府からの投資を背景に、ビッグデータやAIを活用した新しい産業の育成が積極的に進められています。中国政府は、2015年5月に産業政策として「中国製造2025」を発表し、重点分野の一つとして次世代情報技術(半導体、5G、AI)を掲げ、2017年7月には新たに国家戦略として「次世代人工知能発展計画(※85)」を発表し、2030年までのロードマップを提示しました。

この計画では、目標として、2020年までにAI技術及び応用を世界先進水準に、2025年までにAI基礎理論を進展させ、一部の技術と応用を世界トップレベルに、最終的には2030年までにAIの理論、技術、応用の全てを世界トップレベルに引き上げ、AIの中核産業の規模を1兆元超にするとともに、牽引(けんいん)される関連産業の規模を10兆元超に成長させることを掲げ、研究開発や人材育成など様々な取組が包含されています。同計画の下、中国政府は、「国家次世代オープン・イノベーション・プラットフォーム」として、5社5分野(医用画像認識はTencent社、スマートシティはAlibaba Cloud社、自動運転はBaidu社、音声認識はiFLYTEK社、画像処理はSenseTime社)を指定し、技術実証や実装を支援しています(※86)。

また、2024年3月の全国人民代表大会における政府活動報告の中で、AIの研究開発と応用を進めデジタル産業クラスターの形成を目指す「AIプラス・イニシアティブ」の立ち上げが発表されました(※87)。

AIのリスクやガバナンスについては、2017年の次世代人工知能発展計画の中で倫理規範の重要性も指摘され、中国国家次世代人工知能ガバナンス専門委員会を設立するとともに、2019年6月には「次世代人工知能ガバナンス原則─責任ある人工知能の発展」、2021年9月には「次世代AI倫理規範」も発表されています(※88)。さらに、2023年8月には、当局による事前審査の義務付け等を規定した「生成AIサービス管理暫定弁法(※89)」が施行されています。

1-9.シンガポール

シンガポールでは、2014年に発表された「スマート国家構想」に基づき、最先端のデジタル技術の開発や活用に関する様々なプロジェクトが展開される中で、AIに関する研究開発や人材育成も積極的に進められてきました。具体的には、2017年にはAI分野の人材育成を進めるプログラム「AIシンガポール(AISG)」を創設するとともに、2019年にはAIの利活用の促進を通じた経済の変革を目指した「国家AI戦略(NAIS)(※90)」を発表し、大学や企業等における研究開発や利活用が促進されてきました。またそのような取組を通じて、1,100ものAIスタートアップ企業がシンガポールを本拠地に選ぶなど、AIエコシステムの形成が進められてきました。

さらに、2023年12月には、シンガポール政府は、新たに「国家AI戦略2.0(NAIS2.0)(※91)」を発表するとともに、東南アジア地域初の大規模言語モデルである「SEA-LION(※92)」の開発を含む、LLMの研究開発のための、7,000万シンガポールドルのイニシアティブを開始しました(※93)。SEA-LIONは、東南アジアでも少数の民族グループやリソースの少ない言語にも対応することを目指して構築されています。

現在は、ベースモデルとして30億パラメータモデルと70億パラメータモデル、そして英語とインドネシア語に特化した70億インストラクトモデルの計3種類が利用可能になっています(※94)。

第2節 AIに関する多国間の連携と協働

● 経済開発協力機構(OECD)

OECD諸国において、AIが経済、社会、環境など様々な分野で人間生活の一部として機能するようになる一方で、自由なAIの活用は現実世界に様々なリスクや疑心を招く可能性があるとの懸念が高まる中、創造的かつ信頼でき、なおかつ人権と民主的価値を尊重するようなAIの活用を推進する目的で、2019年(令和元年)5月に「OECD AI原則(※95)」が策定されました。この原則は、AIを実用的、流動的に長く活用していくためのAIに関する世界初の国家間の基準として採択され、そのOECD AI原則の内容は、翌月開催されたG20大阪サミットにおいても、そのままG20 AI原則として承認されています。

そして、AIに関する各国の取組の情報共有を進めるため、2020年(令和2年)には「OECD AI Policy Observatory(OECD.AI)」が設立されました。OECD.AIは前述の原則を推進するとともに、各国がAIに関する政策を比較し、客観的根拠に基づいた政策形成を実施できるよう、約70の国・地域のAIに関する研究、データ、さらにはトレンドに関するデータセットを公開しています(※96)。

● AIに関する国際連携イニシアティブ(GPAI(※97))

2020年(令和2年)に、人権と民主的価値を尊重するようなAIの活用を推進する国際連携のイニシアティブとして、GPAIが設立されました。GPAIは、人間中心の考えに立ち「責任あるAI」の開発・利用を実現するために設立された国際官民連携組織であり、その設立は、2019年(令和元年)8月にフランスで開催されたG7ビアリッツサミットにおいて、必要性が提唱されたことに端を発します。同サミットでは、AIの開発と利用において「人間中心の価値」を尊重し、AIの潜在的なリスクを軽減するための国際的な協力の必要性が確認されました。これを受け、2020年(令和2年)5月に開催されたG7科学技術大臣会合において、GPAIの設立に向けたG7の協力が合意に至りました。その後、2020年(令和2年)6月にGPAIの設立宣言が採択されて、正式に設立されました(※98)。2022年(令和4年)11月には年次総会であるGPAIサミットが東京において開催され、2022年(令和4年)11月から2023年(令和5年)12月にかけて、我が国が議長国を務めました。

GPAIには、2024年(令和6年)3月現在で29の国・地域が参加しており、各国はAIの開発と利用において民主主義、人権、包摂、多様性、イノベーションなどの価値観を共有しています(※99)。またGPAIは、AIの責任ある開発・利用を実現するための取組を進めており、責任あるAI、データ・ガバナンス、仕事の未来、イノベーションと商業化の四つのテーマについて専門家のワーキンググループを設置し、プロジェクトを実施しています。今後も、AIの健全な発展と社会への利活用を促進するために、GPAIの活動が期待されます。

● G7「広島AIプロセス」

2023年(令和5年)は、G7議長国として、我が国がAIガバナンスの分野における国際的な議論を主導しました。2023年(令和5年)4月に開催されたG7群馬高崎デジタル・技術大臣会合、5月に開催されたG7広島サミットを踏まえ、生成AIについて、そのガバナンスの必要性から、ガバナンスの在り方、知的財産権保護、透明性促進、偽情報への対策及び生成AI技術の責任ある活用等の諸課題について議論する「広島AIプロセス」を立ち上げ、G7メンバーはOECD、GPAIとも連携して、議論を進めてきました。同年9月にオンライン開催された広島AIプロセス閣僚級会合や10月のインターネット・ガバナンス・フォーラム2023京都会合で開催されたマルチステークホルダーハイレベル会合等を経て、10月に「広島AIプロセスに関するG7首脳声明」を発出し、「高度なAIシステムを開発する組織向けの広島プロセス国際指針」及び「高度なAIシステムを開発する組織向けの広島プロセス国際行動規範」を公表しました。

さらにG7首脳からの指示を踏まえ、12月には再度G7デジタル・技術閣僚会合を開催し、日本のG7議長国下での広島AIプロセスの成果物として、「国際指針」、「国際行動規範」を含む「広島AIプロセス包括的政策枠組み」がG7デジタル・技術閣僚声明において承認され、その後、これらの成果についてG7首脳声明で承認されました。閣僚声明の主なポイントは以下のとおりです。

(1)以下の4要素から構成される「広島AIプロセス包括的政策枠組み」の策定

①生成AIに関するG7の共通理解に向けたOECDレポート(G7共通の優先的な課題・リスク及び機会を例示)

②全てのAI関係者向け及びAI開発者向け広島プロセス国際指針

③高度なAIシステムを開発する組織向けの広島プロセス国際行動規範

④偽情報対策に資する研究の促進等のプロジェクトベースの協力(OECD、GPAI、UNESCO等の国際機関等と協力し、AIによって生成された偽情報を識別するための最先端の技術的能力に関する研究の促進等、プロジェクトベースの取組を推進することを計画)

(2)広島AIプロセスを前進させるための作業計画(賛同国増加に向けたアウトリーチ、国際行動規範への支持拡大及び企業等による国際行動規範履行確保のためのモニタリングツールの導入に向けた取組、OECD、GPAI、UNESCOとのプロジェクトベースの協力の継続)

2024年(令和6年)のG7の議長国イタリアは、安全・安心・信頼できるAIの普及に向けて、昨年のG7日本議長国下で立ち上げた「広島AIプロセス」を継続して推進することを表明しました。3月に開催されたG7産業・技術・デジタル大臣会合で採択された「G7産業・技術・デジタル閣僚宣言」では、G7が、主要なパートナー国や企業等からの認知及び支持の拡大等を通じて、今後も広島AIプロセスの成果を前進させることに引き続きコミットすることを確認し、開発途上国・新興経済国を含む主要なパートナー国や組織における広島AIプロセス国際指針及び国際行動規範の普及、採択、適用を促進するためのアクションが歓迎されました。

● 国際連合

AIの開発や利用に関する規制や管理の在り方について、国連でも議論が進められています。AIが人類のより大きな利益のために活用されることを目指す国連の取組を支援する目的で、国連事務総長の主導の下、国連ハイレベルAI諮問機関が2023年10月に設立されました。2023年12月には、AIのリスク、機会及び国際的なガバナンスについて検討した結果を取りまとめた中間報告書が公表されました(※100)。

また、国連加盟国やステークホルダーに対し、安全、安心で信頼できるAIの実現のために協力するよう求める総会決議案「持続可能な開発のための安全、安心で信頼できるAIシステムに係る機会確保」を米国が提出し、最終的には日本を含む120以上の国・地域が共同提案し、2024年3月、国連総会で、コンセンサスで採択されました(※101)。

コラム1-3 AI研究に関わる研究者

●江間有沙氏

東京大学国際高等研究所 東京カレッジ准教授

博士(学術) 専門:科学技術社会論

江間さんの専門は科学技術社会論で、科学技術社会論とは科学技術が政治や経済、文化などの社会との界面で生じる課題を研究する学問であり、社会に埋もれた課題を指摘する側面と、その課題への対策を社会に働きかける側面も持つ領域です。

江間さんは元々、大学にはいわゆる文科系として入学しましたが、「一人学際」と称して文理問わず講義を受ける中で、もっと理工系の分野を学びたいという思いを抱き、学部2年次末の進路選択の際に理科系の進路に転身しました。科学技術を対象としながら社会や文化について考えることに魅力を感じ、科学技術社会論を知ったそうです。修士課程に進学するかは悩んだそうですが、たまたま出会った方から「いつかアカデミアに戻ってくるつもりがあるならば、修士に進んだ方が良い」というアドバイスを受けたこともあり進学を決意しました。その後、日本学術振興会の特別研究員に選ばれるといった制度的な後押しもあり博士課程まで進学し、研究の道に進むことにしたそうです。

最近は、AIと社会との関係について広く研究されています。AIは既に様々な場面で使われ、気づかぬうちに社会や生活に深く入り込んでいると言います。生活を便利にする反面、差別や不公正など課題もあることから、AIを安全で適切に利用するガバナンスの在り方を模索しており、その一環として、市民、企業、研究者が垣根を超えて課題や活用法を話し合う、場づくりにも取り組まれています。

また、2023年10月には、国連事務総長が招集したAIに関するマルチステークホルダーによるハイレベル諮問機関の構成員に選出されました。現在は2024年9月に開催される国連未来サミットに向けて、国際的なAIガバナンスに関する報告を取りまとめるために議論を深めています。江間さんは社会科学分野の研究者として参加しており、マルチステークホルダーが議論しやすいような土壌を作ること、また声の上げにくい人たちをどのように議論に参加させていけばいいのかを検討することなどについて貢献したいと話します。国際的な場で活躍されている江間さんに、国際社会における日本の位置付け、役割をお聞きしたところ、「日本は欧米と価値観を共有しつつ、アジアとも価値観を共有できる国です。発言力はそれなりにある一方で、強く主張する国ではなく全体のバランスが取れる。そして、先人たちが培ってきた信頼があり日本に対し好意的な人が多いため、例えば、日本で会議をやるなら行きます、と言ってくれる人も多い。こうしたことから、日本は欧米とアジアの調整を担うことが求められているのではないか。」と答えてくれました。地政学リスクが顕在化している現代において、日本に求められる役割は、今後も更に大きくなるかもしれません。

● 欧州評議会の「AI、人権、民主主義、法の支配に関する枠組条約」

人権、民主主義、法の支配の分野で国際社会の基準策定を主導する汎欧州の国際機関で、日本、米国、カナダ、メキシコ等もオブザーバー国として参加している欧州評議会(Council of Europe)においても、「AI、人権、民主主義、法の支配に関する枠組条約」について議論が進められています。

- ※1 Stanford Institute for Human-Centered Artificial Intelligence “Artificial Intelligence Index Report 2024”

https://aiindex.stanford.edu/report/

Goldman Sacks社 “AI investment forecast to approach $200 billion globally by 2025”

https://www.goldmansachs.com/intelligence/pages/ai-investment-forecast-to-approach-200-billion-globally-by-2025.html - ※2 Association for the Advancement of Artificial Intelligence

- ※3 文部科学省科学技術・学術政策研究所「人工知能分野及びロボティクス分野の国際会議における国別発表件数の推移等に関する分析」(2023年5月)

https://nistep.repo.nii.ac.jp/records/6846 - ※4 Select Committee on Artificial Intelligence of the National Science and Technology Council “National Artificial Intelligence Research and Development Strategic Plan 2023 Update”

https://www.whitehouse.gov/wp-content/uploads/2023/05/National-Artificial-Intelligence-Research-and-Development-Strategic-Plan-2023-Update.pdf - ※5 Congress.gov “H.R.6216 - National Artificial Intelligence Initiative Act of 2020”

https://www.congress.gov/bill/116th-congress/house-bill/6216 - ※6 National Artificial Intelligence Initiative Office

- ※7 Office of Science and Technology Policy

- ※8 The White House “The White House Launches the National Artificial Intelligence Initiative Office”

https://trumpwhitehouse.archives.gov/briefings-statements/white-house-launches-national-artificial-intelligence-initiative-office/ - ※9 National Science and Technology Council

- ※10 Select Committee on AI

https://www.whitehouse.gov/ostp/ostps-teams/nstc/select-committee-on-artificial-intelligence/ - ※11 National AI Initiative Advisory Committee

https://ai.gov/wp-content/uploads/2023/10/NAIAC-Charter.pdf - ※12 The White House “FACT SHEET: Biden-Harris Administration Secures Voluntary Commitments from Leading Artificial Intelligence Companies to Manage the Risks Posed by AI”

https://www.whitehouse.gov/briefing-room/statements-releases/2023/07/21/fact-sheet-biden-harris-administration-secures-voluntary-commitments-from-leading-artificial-intelligence-companies-to-manage-the-risks-posed-by-ai/

The White House “FACT SHEET: Biden-Harris Administration Secures Voluntary Commitments from Eight Additional Artificial Intelligence Companies to Manage the Risks Posed by AI”

https://www.whitehouse.gov/briefing-room/statements-releases/2023/09/12/fact-sheet-biden-harris-administration-secures-voluntary-commitments-from-eight-additional-artificial-intelligence-companies-to-manage-the-risks-posed-by-ai/ - ※13 The White House “The White House Executive Order on the Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence”

https://www.whitehouse.gov/briefing-room/presidential-actions/2023/10/30/executive-order-on-the-safe-secure-and-trustworthy-development-and-use-of-artificial-intelligence/ - ※14 National Institute of Standards and Technology

- ※15 U.S. Artificial Intelligence Safety Institute

https://www.nist.gov/artificial-intelligence-safety-institute

2024年2月には、USAISIの幹部人事や、コンソーシアム体制が発表されている。 - ※16 The White House “FACT SHEET: Vice President Harris Announces New U.S. Initiatives to Advance the Safe and Responsible Use of Artificial Intelligence”

https://www.whitehouse.gov/briefing-room/statements-releases/2023/11/01/fact-sheet-vice-president-harris-announces-new-u-s-initiatives-to-advance-the-safe-and-responsible-use-of-artificial-intelligence/ - ※17 U.S. Copyright Office

- ※18 USCO “Copyright and Artificial Intelligence”

https://www.copyright.gov/ai/ - ※19 National Science Foundation

- ※20 NSF “NSF announces 7 new National Artificial Intelligence Research Institutes”

https://new.nsf.gov/news/nsf-announces-7-new-national-artificial - ※21 NSF “NSF invests $10.9M in the development of safe artificial intelligence technologies”

https://new.nsf.gov/news/nsf-invests-10-9m-development-safe-ai-tech - ※22 National Artificial Intelligence Research Resource

- ※23 The White House “National Artificial Intelligence Research Resource Task Force Releases Final Report”

https://www.whitehouse.gov/ostp/news-updates/2023/01/24/national-artificial-intelligence-research-resource-task-force-releases-final-report/ - ※24 Institute of Education Science under the U.S. Department of Education

- ※25 NSF “National Artificial Intelligence Research Resource Pilot”

https://new.nsf.gov/focus-areas/artificial-intelligence/nairr - ※26 Defense Advanced Research Projects Agency

- ※27 DARPA “DARPA Announces $2 Billion Campaign to Develop Next Wave of AI Technologies”

https://www.darpa.mil/news-events/2018-09-07 - ※28 Automating Scientific Knowledge Extraction and Modeling

- ※29 DARPA “Leveraging AI to Accelerate Development of Scientific Models”

https://www.darpa.mil/news-events/2021-12-06 - ※30 DARPA “DARPA Selects Teams to Improve How Scientists Build/Sustain Models, Simulations”

https://www.darpa.mil/news-events/2022-09-23 - ※31 Microsoft社「AI プラットフォーム、ツール、サービス」

https://www.microsoft.com/ja-jp/ai/ai-platform - ※32 The Alan Turing Institute

https://www.turing.ac.uk/about-us - ※33 アラン・チューリング研究所は、データ・サイエンスを研究対象として、2015年にEPSRC、ケンブリッジ大学、オックスフォード大学、エディンバラ大学、UCL、ウォーリック大学の支援を得て、英国政府によりロンドンに設立された研究所であるが、2017年にはAIが研究対象として明確化されるとともに、2018年にはロンドン大学クイーンメアリー校、リーズ大学、マンチェスター大学、ニューカッスル大学、サウサンプトン大学、バーミンガム大学、エクセター大学、ブリストル大学の8大学も加わり、英国におけるAI研究の中核研究拠点として、AIを活用した医療の高度化や、AIを活用した製造業の効率化など様々な共同研究が進められている。

- ※34 National Health Service

- ※35 NHS user experience

- ※36 The NHS AI Lab

https://transform.england.nhs.uk/ai-lab/ - ※37 Government of the United Kingdom “National AI Strategy”

https://www.gov.uk/government/publications/national-ai-strategy - ※38 Government of the United Kingdom “National AI Strategy - AI Action Plan”

https://www.gov.uk/government/publications/national-ai-strategy-ai-action-plan/national-ai-strategy-ai-action-plan - ※39 Government of the United Kingdom “Britain to be made AI match-fit with £118 million skills package”

https://www.gov.uk/government/news/britain-to-be-made-ai-match-fit-with-118-million-skills-package - ※40 Department for Science, Innovation and Technology

- ※41 Government of the United Kingdom “UK Science and Technology Framework”

https://www.gov.uk/government/publications/uk-science-and-technology-framework - ※42 Government of the United Kingdom “Plan to forge a better Britain through science and technology unveiled”

https://www.gov.uk/government/news/plan-to-forge-a-better-britain-through-science-and-technology-unveiled - ※43 Government of the United Kingdom “£54 million boost to develop secure and trustworthy AI research”

https://www.gov.uk/government/news/54-million-boost-to-develop-secure-and-trustworthy-ai-research - ※44 UK Research and Innovation

- ※45 Strategic Artificial Intelligence Research Centre

※同センターが設置されていた「人類の未来研究所(Future of Humanity Institute)」の2024年4月の閉鎖に伴い、同センターも閉鎖された。 - ※46 Leverhulme Centre for the Future of Intelligence

http://lcfi.ac.uk/ - ※47 Government of the United Kingdom “AI regulation: a pro-innovation approach”

https://www.gov.uk/government/publications/ai-regulation-a-pro-innovation-approach - ※48 Government Office for Science “Future Risks of Frontier AI”

https://assets.publishing.service.gov.uk/media/653bc393d10f3500139a6ac5/future-risks-of-frontier-ai-annex-a.pdf - ※49 Government of the United Kingdom “AI Safety Summit 2023”

https://www.gov.uk/government/topical-events/ai-safety-summit-2023 - ※50 UK Artificial Intelligence Safety Institute

https://www.gov.uk/government/organisations/ai-safety-institute - ※51 UK Parliament “UK will miss AI goldrush unless Government adopts a more positive vision”

https://committees.parliament.uk/work/7827/large-language-models/news/199728/uk-will-miss-ai-goldrush-unless-government-adopts-a-more-positive-vision/ - ※52 UK Parliament “Artificial Intelligence (Regulation) Bill [HL]”

https://bills.parliament.uk/bills/3519 - ※53 Privacy Enhancing Technologies

- ※54 Government of the United Kingdom “UK and US launch innovation prize challenges in privacy-enhancing technologies to tackle financial crime and public health emergencies”

https://www.gov.uk/government/news/uk-and-us-launch-innovation-prize-challenges-in-privacy-enhancing-technologies-to-tackle-financial-crime-and-public-health-emergencies - ※55 Government of the United Kingdom “At Summit for Democracy, the United Kingdom and the United States Announce Winners of Challenge to Drive Innovation in Privacy-Enhancing Technologies that Reinforce Democratic Values”

https://www.gov.uk/government/news/at-summit-for-democracy-the-united-kingdom-and-the-united-states-announce-winners-of-challenge-to-drive-innovation-in-privacy-enhancing-technologies - ※56 European Commission “Artificial Intelligence for Europe”

https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=COM:2018:237:FIN - ※57 その後EU理事会の承認を経て成立(2024年5月21日承認)

- ※58 European Parliament “Artificial Intelligence Act: MEPs adopt landmark law”

https://www.europarl.europa.eu/news/en/press-room/20240308IPR19015/artificial-intelligence-act-meps-adopt-landmark-law - ※59 European Parliament “TEXTS ADOPTED: Artificial Intelligence Act”

https://www.europarl.europa.eu/doceo/document/TA-9-2024-0138_EN.pdf - ※60 General-purpose Artificial Intelligence

- ※61 European Commission “Commission launches AI innovation package to support Artificial Intelligence startups and SMEs”

https://ec.europa.eu/commission/presscorner/detail/en/ip_24_383 - ※62 The European High-Performance Computing Joint Undertaking

- ※63 AI研究分野をリードする六つの研究機関で構成されたネットワーク Deutsches Forschungszentrum für Künstliche Intelligenz(ドイツ人工知能研究センター)“Network of German Centres of Excellence for AI Research”

https://www.dfki.de/en/web/qualifications-networks/networks-initiatives/centres-of-excellence-for-ai-research - ※64 ドイツ連邦政府 “BMBF VERÖFFENTLICHT KI-AKTIONSPLAN”

https://www.ki-strategie-deutschland.de/home.html

ドイツ連邦政府 “Artificial Intelligence Strategy”

https://www.ki-strategie-deutschland.de/home.html?file=files/downloads/Nationale_KI-Strategie_engl.pdf&cid=729 - ※65 ドイツ連邦政府 “Artificial Intelligence Strategy of the German Federal Government 2020 Update”

https://www.ki-strategie-deutschland.de/home.html?file=files/downloads/Fortschreibung_KI-Strategie_engl.pdf&cid=955 - ※66 フランス経済・財務・産業・デジタル主権省 “La stratégie nationale pour l'intelligence artificielle”

https://www.economie.gouv.fr/strategie-nationale-intelligence-artificielle

科学技術振興機構研究開発戦略センター(2024)「主要国・地域の科学技術・イノベーション政策動向(2024年)」 - ※67 フランス高等教育・研究省 “La stratégie nationale de recherche en intelligence artificielle”

https://www.enseignementsup-recherche.gouv.fr/fr/la-strategie-nationale-de-recherche-en-intelligence-artificielle-49166 - ※68 Institut National de Recherche en Informatique et en Automatique

- ※69 Agence Nationale de la Recherche

- ※70 フランス経済・財務・産業・デジタル主権省 “STRATÉGIE NATIONALE POUR L'INTELLIGENCE ARTIFICIELLE – 2e phase”

https://presse.economie.gouv.fr/wp-content/uploads/2021/11/8bcf2b43571df79a59055eab0cc5047e.pdf - ※71 フランス経済・財務・産業・デジタル主権省 “Numérique : la France se dote d'un comité de l'intelligence artificielle générative”

https://www.economie.gouv.fr/comite-intelligence-artificielle-generative - ※72 イタリア政府 “Strategic Programme on Artificial Intelligence 2022-2024”

https://assets.innovazione.gov.it/1637777513-strategic-program-aiweb.pdf - ※73 Canadian Institute for Advanced Research

- ※74 日本貿易振興機構(2018)「AI スーパークラスター トロント、モントリオール」

- ※75 Government of Canada “Pan-Canadian Artificial Intelligence Strategy”

https://ised-isde.canada.ca/site/ai-strategy/en - ※76 Government of Canada “Government of Canada launches second phase of the Pan-Canadian Artificial Intelligence Strategy”

https://www.canada.ca/en/innovation-science-economic-development/news/2022/06/government-of-canada-launches-second-phase-of-the-pan-canadian-artificial-intelligence-strategy.html - ※77 Alberta Machine Intelligence Institute

https://www.amii.ca/ - ※78 Montreal Institute for Learning Algorithms

https://mila.quebec/en/mila/

1993年にベンジオ氏が創設。現在ではケベック州内のモントリオール大、マギル大など4大学協働の下で運営されている。 - ※79 Vector Institute

https://vectorinstitute.ai/ - ※80 CIFAR “The Pan-Canadian AI Strategy”

https://cifar.ca/ai/ - ※81 CIFAR “AICan: The Impact of the Pan-Canadian AI Strategy”

https://cifar.ca/ai/impact/ - ※82 カナダ連邦政府 “Government of Canada supports creation of AI computing cluster at Université Laval”

https://www.canada.ca/en/innovation-science-economic-development/news/2024/03/government-of-canada-supports-creation-of-ai-computing-cluster-at-universite-laval.html - ※83 カナダ連邦政府 “Voluntary Code of Conduct on the Responsible Development and Management of Advanced Generative AI Systems”

https://ised-isde.canada.ca/site/ised/en/voluntary-code-conduct-responsible-development-and-management-advanced-generative-ai-systems - ※84 カナダ連邦政府 “Artificial Intelligence and Data Act”

https://ised-isde.canada.ca/site/innovation-better-canada/en/artificial-intelligence-and-data-act - ※85 国务院「新一代人工智能发展规划的通知 」

https://www.gov.cn/zhengce/content/2017-07/20/content_5211996.htm

新エネルギー・産業技術総合開発機構 北京事務所「次世代人工知能発展計画」(仮訳)https://www.nedo.go.jp/content/100903937.pdf - ※86 前掲 科学技術振興機構研究開発戦略センター(2024)「主要国・地域の科学技術・イノベーション政策動向(2024年)」

- ※87 科学技術振興機構アジア・太平洋総合研究センター「全人代2024、科学技術関連内容を読み解く」

https://spc.jst.go.jp/experiences/economy/economy_2418.html - ※88 前掲 科学技術振興機構研究開発戦略センター(2024)「主要国・地域の科学技術・イノベーション政策動向(2024年)」

- ※89 国家インターネット情報弁公室「生成式人工智能服务管理暂行办法」

https://www.cac.gov.cn/2023-07/13/c_1690898327029107.htm - ※90 シンガポール政府 “Singapore National AI Strategy”

https://file.go.gov.sg/nais2019.pdf - ※91 シンガポール政府 “Singapore National AI Strategy 2.0 (NAIS2.0)”

https://file.go.gov.sg/nais2023.pdf - ※92 Southeast Asian Languages In One Network

- ※93 Infocomm Media Development Authority “Singapore pioneers S$70m flagship AI initiative to develop Southeast Asia's first large language model ecosystem catering to the region's diverse culture and languages”

https://www.imda.gov.sg/resources/press-releases-factsheets-and-speeches/press-releases/2023/sg-to-develop-southeast-asias-first-llm-ecosystem - ※94 AI Singapore “SEA-LION”

https://aisingapore.org/aiproducts/sea-lion/ - ※95 OECD Legal Instruments “Recommendation of the Council on Artificial Intelligence”

https://legalinstruments.oecd.org/en/instruments/OECD-LEGAL-0449 - ※96 OECD.AI “Trends & data overview”

https://oecd.ai/en/trends-and-data - ※97 The Global Partnership on Artificial Intelligence

- ※98 総務省(2023)「令和5年版情報通信白書」

https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/r05/html/nd258590.html - ※99 GPAI “About GPAI”

https://gpai.ai/about/ - ※100 United Nations “Governing AI for Humanity”

https://www.un.org/sites/un2.un.org/files/un_ai_advisory_body_governing_ai_for_humanity_interim_report.pdf - ※101 United Nations “General Assembly adopts landmark resolution on artificial intelligence”

https://news.un.org/en/story/2024/03/1147831

お問合せ先

科学技術・学術政策局研究開発戦略課